隨著人工智能技術(shù)的快速迭代與應(yīng)用普及,百度CEO李彥宏多次在公開場合指出,人工智能在賦能社會進步的其引發(fā)的數(shù)據(jù)安全隱患問題不容忽視。尤其是在人工智能基礎(chǔ)軟件開發(fā)領(lǐng)域,數(shù)據(jù)安全已成為行業(yè)健康發(fā)展的關(guān)鍵挑戰(zhàn)。

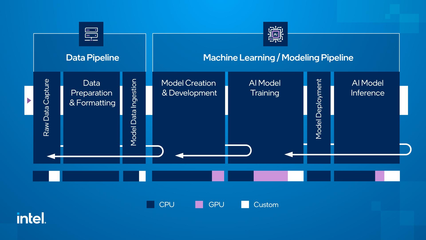

一方面,人工智能技術(shù)依賴海量數(shù)據(jù)進行訓(xùn)練與優(yōu)化,而數(shù)據(jù)采集、存儲與處理過程中存在泄露、濫用風(fēng)險。例如,在自然語言處理、計算機視覺等基礎(chǔ)軟件中,用戶隱私信息可能因模型訓(xùn)練而被無意整合,若缺乏嚴格的數(shù)據(jù)脫敏與加密機制,極易導(dǎo)致敏感信息外泄。李彥宏曾強調(diào),企業(yè)需建立'技術(shù)向善'的倫理觀,在基礎(chǔ)軟件設(shè)計階段嵌入數(shù)據(jù)保護架構(gòu)。

另一方面,人工智能基礎(chǔ)軟件作為技術(shù)生態(tài)的基石,其安全性直接影響上下游應(yīng)用。開源框架的漏洞可能被惡意利用,模型投毒攻擊會導(dǎo)致決策偏差,而深度偽造等技術(shù)的濫用更可能引發(fā)社會信任危機。對此,李彥宏提出應(yīng)推動'安全左移'策略,在軟件開發(fā)初期就引入安全審計與動態(tài)監(jiān)測機制,同時加強行業(yè)標準建設(shè),例如通過聯(lián)邦學(xué)習(xí)等技術(shù)實現(xiàn)'數(shù)據(jù)可用不可見'。

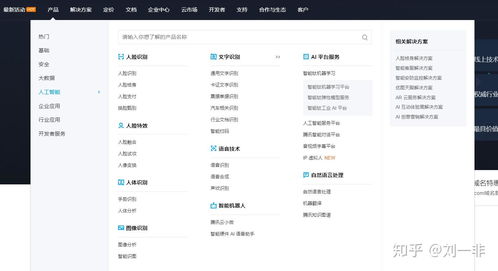

為應(yīng)對這些挑戰(zhàn),需從三方面著力:一是強化技術(shù)防護,開發(fā)具有隱私計算能力的基礎(chǔ)軟件平臺;二是完善法律法規(guī),明確數(shù)據(jù)權(quán)屬與算法問責(zé)機制;三是培育跨領(lǐng)域人才,推動安全專家與AI研發(fā)者的深度協(xié)作。正如李彥宏所言:'AI發(fā)展的速度必須與安全體系的完善程度同步',唯有在基礎(chǔ)軟件層面筑牢數(shù)據(jù)安全防線,人工智能技術(shù)才能真正成為造福人類的可持續(xù)動力。